PT no Senado

Inteligência artificial nas eleições é o primeiro tema da revista Farol, produzido pelo PT no Senado

Por meio da tecnologia, um militar cruel, acusado de diversos crimes contra a humanidade, foi retratado em vídeos com um “vovô fofinho” durante a campanha eleitoral e acabou eleito presidente da Indonésia. Casos como esse, onde a inteligência artificial é usada para manipular eleitores, foram analisados em um estudo produzido pela assessoria técnica do PT no Senado. O assunto, que está no centro dos debates do Senado nesta semana, é o tema da primeira edição da nova revista de estudos técnicos da Liderança do PT no Senado, chamada “Farol” (leia na íntegra abaixo).

Sob o título “O uso de inteligência artificial para gerar desinformação eleitoral”, o trabalho produzido pelas assessoras Sarah Vale e Elisângela Pontes investiga como a tecnologia vem sendo usada para disseminar mentiras e analisa formas de como lidar com o avanço desses métodos.

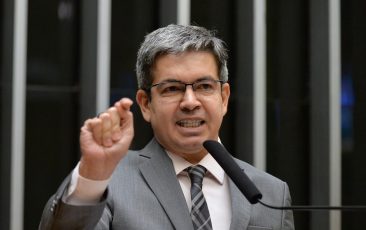

Para o líder do PT no Senado, Beto Faro (PA), a publicação traz à tona as consequências que a nova tecnologia acarretam à população. “É preciso alertar e buscar soluções para os riscos da manipulação de informações. Este estudo mostra o quanto é fundamental que os poderes públicos se debrucem o quanto antes sobre o tema para iniciar um processo não de censura, mas de regulação, para garantir eleições mais justas e uma sociedade mais protegida”, disse.

A preocupação com a influência de eleitores é comprovado em pesquisas. Um levantamento de 2019 do DataSenado, que ouviu 2.400 pessoas com acesso à internet, mostrou que quase metade dos entrevistados (45%) afirmam ter decidido o voto levando em consideração postagens vistas em alguma rede social. Para piorar, 47% dos cidadãos ouvidos reconheceram ser difícil identificar a veracidade das informações.

“A ausência de mecanismos para assegurar aos usuários a veracidade das mensagens que recebem em suas redes sociais agrava a preocupação. Assim, analisar as recentes experiências eleitorais pode nos proporcionar uma compreensão maior dos desafios que as próximas eleições brasileiras enfrentarão diante da crescente presença da IA generativa no contexto político”, diz o estudo do PT no Senado.

A inteligência artificial generativa, aliás, é um dos principais alvos de análise do trabalho. Tal tecnologia é capaz até mesmo de utilizar o rosto de pessoas em vídeos ou áudios manipulados – os chamados deepfakes.

Além disso, o documento analisa as abordagens adotadas nos Estados Unidos e na União Europeia para conter a desinformação nas eleições e discute medidas que estão sendo elaboradas no Brasil pelos poderes Judiciário e Legislativo para mitigar os efeitos negativos da IA nas eleições.

Em entrevista ao site do PT no Senado, Sarah e Elisângela destacam que o tema deve ser tratado com urgência pelas autoridades e destacam um meio fundamental para lidar com o problema: educar a população sobre o tema, tanto por meio de campanhas de comunicação quanto já nas salas de aula.

PT no Senado: Como está o debate da inteligência artificial em outros países e como isso pode nos ajudar na regulação do tema aqui no Brasil?

Elisângela Pontes: Na maioria dos países, o tema IA está causando muitos problemas, e um dos alertas que fazemos é sobre a necessidade da regulação.

Mas a regulação que tratamos não é com uma visão muito fechada e punitiva. É para colocar limites, pra que a gente possa ter a convivência mais saudável e democrática possível dentro desse mundo que é a internet, que costumamos dizer que é um mundo sem lei, sem limite, sem regras.

Acho que esse tempo já passou, e agora é o momento de esse dialogar e se buscar limites pra essa convivência mais saudável, plural, democrática e respeitosa possível.

E, no Brasil, a gente vai passar por um momento muito delicado e complexo, que são as eleições municipais. É preciso aproveitar o momento para, como defende a presidenta do Tribunal Superior Eleitoral (TSE), ministra Cármen Lúcia, acabar com essa questão da mentira nas eleições. No nosso trabalho, buscamos chamar a atenção para o tema.

No estudo, buscamos chamar a atenção dos parlamentares para que eles também coloquem esse tema como um dos mais importantes para sua atividade política.

Não é uma coisa do estado, do país em si. É uma articulação, uma negociação muito difícil, lenta até. E aqui no Senado a gente tem a oportunidade de já tratar disso, por meio do Projeto de Lei (PL) 2.338/2023, de autoria do presidente Pacheco e relatoria do senador Eduardo Gomes, e que trata da regulação da IA.

PT no Senado: Recentemente, o líder do PT no Senado falou sobre a preocupação que o Brasil deve ter em relação ao combate aos deepfakes, por exemplo, que usam o rosto de pessoas em vídeos alterados por meio de IA ou criam áudios mentirosos perfeitos tecnicamente. Como vocês avaliam o avanço desse tipo de manipulação?

Sarah: É impossível proibir métodos como esse, mas podemos mitigar os malefícios que ele traz. Mas a gente sabe que, mesmo com alertas nas redes sociais sobre conteúdos assim, vão ter sistemas capazes de burlar isso.

A inteligência artificial está aí. Não tem como a gente bani-la do processo democrático. A gente vai ter que saber lidar com ela. Inclusive, trazemos no nosso estudo muitos exemplos de deepfakes que aconteceram no exterior, como na Argentina e na Indonésia. Mostramos, também, exemplos no Brasil, uma vez que já começou, na pré-campanha, a alteração de voz de alguns candidatos. A gente tem que, de algum modo, frear isso.

PT no Senado: Qual vocês acham que foi o caso mais emblemático de manipulação de eleitores, no exterior, a partir do uso de inteligência artificial?

Sarah: Acredito que o caso da Indonésia. Pegaram um candidato à presidência do país, Prabowo Subianto, e modificaram toda a imagem dele. Ele é um antigo ditador sanguinário. Criaram vídeos dele, por meio de inteligência artificial generativa, fazendo dancinhas no TikTok. E ele passou a ser, no imaginário dos eleitores, um avô muito gente boa e que faz dancinha.

(Subianto enfrenta acusações de crimes contra a humanidade, incluindo raptos e desaparecimentos forçados de ativistas durante protestos em massa no final dos anos 1990. As acusações, negadas por ele, foram gradualmente esquecidas pelos eleitores, devido à estratégia utilizada nas redes sociais. Subianto venceu as eleições na Indonésia e assumirá a presidência em outubro.)

Elisângela: Tiraram a imagem que Subianto tinha de um ditador, de um homem duro na sua juventude – quando foi mais intensa a sua atuação –, para torná-lo um “vovô bonzinho”. É uma mudança muito drástica, que foi possível, e em tempo recorde, graças à inteligência artificial. Então, a gente tem que, nesse momento de pré-eleição, alfabetizar o eleitor nesse mundo digital.

PT no Senado: Como isso seria feito?

Elisângela: Acho que a gente tem que fortalecer a informação sobre o que é a inteligência artificial e como ela opera. Isso não é uma tarefa fácil, mas é possível. E eu acho que também a gente pode, junto com o Senado, a Câmara dos Deputados, o TSE e os tribunais regionais eleitorais dos estados, criar campanhas de comunicação para explicar sobre o tema às pessoas. A gente tem as instituições mais adequadas e legitimadas para fazer essa comunicação.

Sarah: Acho que esse tema deve ser debatido nas escolas, também.

É preciso deixar claro que a inteligência artificial está sendo operada por humanos. E, por isso, possui viezes discriminatórios: racismo algorítmico, machista, misógino. E é por isso que a gente vê essas problemáticas, já que por trás da IA tem um humano alimentando, tem um dado que foi alimentado – e esse dado está enviesado.

PT no Senado: E as empresas que controlam as redes sociais, como elas podem também atuar nesse controle?

Sarah: Elas têm processos internos que ajudam isso. Vimos que fizeram muito isso durante o período eleitoral nos Estados Unidos e na União Europeia. Mas, aqui no Brasil, as atuações ainda são muito tímidas.

Essas empresas assinaram um termo de compromisso neste sentido com o Supremo Tribunal Federal, mas não explicaram quais seriam as medidas a serem adotadas. Enquanto isso, fora do país, elas já têm medidas drásticas e claras.

Acho que o primordial é a regulação das plataformas digitais, para que elas sejam responsáveis pelos conteúdos que circulam dentro das redes sociais. Não é só dizer de quem é a culpa. Essas empresas têm capacidade de filtrar conteúdos e até impedir que sejam veiculados.

É preciso que essa filtragem passe pelo crivo humano. Acho que, com regulamentação, a gente consegue mitigar um pouco esses danos.

Elisângela: Acredito que o grande desafio para o momento atual é encurtar essa distância que a gente vive entre o mundo analógico e o mundo digital.

É preciso levar conhecimento, tentar chamar a atenção dos jovens e das pessoas idosas, porque elas também são muito vítimas de assédio por meio de conteúdos da internet que chegam até elas. E isso não ocorre se não tiver primeiro vontade das partes e, principalmente, dos poderes constituídos.

PT no Senado: No período eleitoral, enquanto ainda não há uma regulamentação sobre IA, o que pode ser feito para controlar a disseminação de informações pelas redes?

Sarah: As resoluções do TSE em cada período eleitoral são fundamentais neste sentido. Com o passar dos anos, novas tecnologias sempre surgem. Daí a importância de regulamentações para cada período.

Inclusive, nesse processo de regulação da inteligência artificial em debate no Senado, foi uma comissão de juristas que se reuniu e fez a primeira proposta, unindo todas as leis que estavam tramitando na Casa. Finalizaram o projeto e, duas semanas depois, a inteligência artificial generativa surgiu, e acabou não sendo contemplado no projeto de regulamentação da IA.

Elisângela: A evolução da tecnologia é muito rápida. Nunca a lei vai atender a todas as demandas que os tempos atuais nos impõe. A gente vai conviver sempre com essa brecha, mas o importante é começar o debate desses temas e criar normas que tragam princípios e fundamentos que protejam o Estado Democrático de Direito.

Sarah: Então eu acho que juntando o projeto que irá ser aprovado aqui no Senado, mais essas resoluções que são periodicamente expedidas pelo TSE, acho que há a possibilidade de frear um pouco o avanço da desinformação.

PT no Senado: O que pode se somar às normas e leis para contribuir com o controle da desinformação produzida por IA?

Sarah: Usemos como exemplo uma norma do TSE diz que é preciso sinalizar quando o conteúdo é produzido por inteligência artificial. É um bom começo, mas nem sempre é possível identificar esse tipo de produção. Não temos ainda uma ferramenta ou tecnologia que seja capaz de sempre esclarecer o que foi feito ou não por inteligência artificial.

Uma normativa de sinalizar conteúdos produzidos por IA é, sim, necessária, mas acho que é mais importante ainda que as pessoas consigam identificar esses materiais. Por isso, educar as pessoas sobre o tema é fundamental. E esse o método mais eficiente: educar as pessoas nesse novo mundo que a gente vive, que é o mundo digital e que não tem volta.